【机器学习】初啃西瓜书–01绪论

《机器学习》(周志华)西瓜书的学习记录其一

第一章绪论部分包含机器器学习中一些基本概念

这就开始机器学习的学习之旅(。・∀・)ノ

基本概念

把人的“经验”对应计算机中的“数据”,让计算机来学习经验数据,生成一个算法模型,在面对新的情况中,计算机便能作出有效的判断,这便是机器学习。

机器学习致力于研究如何通过计算的手段,利用经验来改善系统自身的性能。主要内容是关于在计算机上从数据中产生模型的算法,即“学习算法”。

🦆yili:有了数据,通过某种学习算法,得到模型,进行预测

模型:泛指从数据中学得的结果,指全局性结果(如一棵决策树)

模式:指局部性结果(如一条规则)

基本术语

数据集

假定我们收集了一批西瓜的数据,例如:(色泽=青绿; 根蒂=蜷缩; 敲声=浊响),(色泽=乌黑; 根蒂=稍蜷; 敲声=沉闷), (色泽=浅自; 根蒂=硬挺; 敲声=清脆),……,每对括号内是一条记录,“=”的意思是“取值为”。

- 数据集:一组记录的集合(如:这组西瓜数据)。

- 样本(示例):每一条记录,关于一个事件或对象的描述(如上述每一条关于西瓜的描述)。

- 属性(特征):反映事件或对象在某一方面的表现或性质的事项(如:“色泽”、“根蒂”)。

- 属性值:属性上的取值(如:“青绿”、“乌黑”)。

- 样本空间(属性空间/输入空间):属性张成的空间。

- 特征向量:把每个属性当作一个坐标轴,则可张成一个n维空间,每一个记录对应一个坐标位置,对应一个向量,因此也把一个示例称为特征向量。(例如:把“色泽”、“根蒂”、“敲声”作为三个坐标轴,则张成一个用于描述西瓜的三维空间,每一个西瓜拥有自己的坐标位置,每个点可以用坐标向量表示)

- 维数:一个样本的特指数。(如上述西瓜例子中维度为3)当维数非常大时称作“维数灾难”。

用数学式表达:D = { x1, x2, …, xm } 表示包含m个示例的数据集,每个实例由d个属性描述 ,则每个示例 xi = (xi1, xi2, …, xid ) 是d维样本空间X中的一个向量,xi∈X,其中xij是xi在第j个属性上的属性值,d称为样本xi的R 维数。

训练集

从数据中学得模型的过程称为“学习”或“训练”。这个过程通过执行某个学习算法完成。通过数据学得模型对应了关于数据的某种潜在规律,被称作“假设”;这种潜在规律自身被称作“真相”(真实),学习的过程就是为了找出或逼近真相。

建立关于预测的模型,需要获得训练样本的“结果”信息,例如“((色泽=青绿; 根蒂=蜷缩; 敲声=浊响),好瓜)”。

- 训练数据:训练过程使用的数据,其中每个样本称为一个“训练样本”。

- 训练集:训练样本组成的集合。

- 验证集:验证训练样本训练结果的集合(第二章介绍)。

- 标记:关于示例结果的信息(如:“好瓜”)。

- 样例:拥有标记信息的示例。

用 ($x_i$,$y_i$) 表示第i个样例,其中$y_i$∈Y是示例$x_i$的标记,Y是所有标记的集合,亦称“标记空间”或“输出空间”。

测试集

学得模型后,使用其进行测试的过程称为“测试”。

如通过西瓜样例学得模型f,对于测试例$x_i$(色泽=$x_{i1}$; 根蒂=$x_{i2}$; 敲声=$x_{i3}$),可得到预测值f($x_i$)(好瓜/不是好瓜)。

- 测试样本:被测试的样本。

- 测试集:测试样本组成的集合。

用f($x_i$)表示$x_i$测试例的预测结果,在回归中可用$\hat{y_i}$表示,真实标记用$y_i$表示,$\hat{y_i}$与$y_i$可能相等也可能不相等。

🦆yili:测试集部分由自己理解所得,可能存在错误

学习任务&划分

一般地,预测任务是希望通过对训练集{($x_1,y_1$), ($x_2,y_2$), …, ($x_m,y_m$)}进行学习,总结出规律,建立一个从输入空间X到输出空间Y的映射,f:X→Y。其中训练集都做了标记,如上述预测瓜好坏。

学习任务也有没有标记信息的情形,如将事物或事件,划分成多份,每一份尽可能相似(聚类当然也有有标记信息的聚类)。

根据训练数据是否有标记信息将学习任务分为:

- 有监督学习

- 分类:预测值是离散值。例如:“好瓜、坏瓜”、“白花、黄花、紫花”

只涉及两个类别称为“二分类”任务,通常令Y={-1,+1}或Y={0,1};

涉及多个类别则称为“多分类”任务,通常|Y|>2。 - 回归:预测值是连续值。例如:“西瓜的甜度(0.0~10.0)”、“身高”

对于回归任务,Y=R,R为实数集。

- 分类:预测值是离散值。例如:“好瓜、坏瓜”、“白花、黄花、紫花”

- 无监督学习

- 聚类:将训练集划分成若干组,每组称为“簇”;自动形成的簇可能对应一些潜在概念的划分。

不知道分为几类,机器自己分 - 关联规则

- 聚类:将训练集划分成若干组,每组称为“簇”;自动形成的簇可能对应一些潜在概念的划分。

泛化能力

机器学习的目标是使学得的模型可以很好的适应“新样本”,而不仅仅在训练样本上工作的好。

学得模型适用于新样本的能力称为“泛化能力”。

训练集通常只是样本空间很小的采样。假设样本空间中全体样本服从一个未知的分布D,获得的每个样本都是独立地从这个分布上采样获得,即“独立同分布”。一般的,训练样本越多,获得关于D的信息越多,越有可能通过学习获得具有强泛化能力的模型。

🦆yili:也不一定训练样本够多就是强泛化

假设空间

归纳和演绎是科学推理的两大基本手段。

- 归纳:从特殊到一般的泛化过程,即从具体的事实归结出一般性规律;

- 侠义归纳:从训练数据中学得概念(概念学习/概念形成)最基础的概念是布尔概念学习

- 广义归纳:从样本中学习

- 演绎:从一般到特殊的特化过程,即从基础原理推演出具体情况。

假如获得训练数据集

| 编号 | 色泽 | 根蒂 | 敲声 | 好瓜 |

|---|---|---|---|---|

| 1 | 青绿 | 蜷缩 | 浊响 | 是 |

| 2 | 乌黑 | 蜷缩 | 浊响 | 是 |

| 3 | 青绿 | 硬挺 | 清脆 | 否 |

| 4 | 乌黑 | 稍蜷 | 闷响 | 否 |

学习的目标是“好瓜”,假设“好瓜”可由“色泽”、“根蒂”、“敲声”三个因素完全确定:

学得的将是“好瓜是某种色泽、某种根蒂、某种敲声的瓜”的概念,用布尔值表示:

好瓜$\Leftrightarrow$(色泽=?)∧(根蒂=?)∧(敲声=?)

其中“?,”表示尚未确定的取值,通过对表中的训练集进行学习,把“?”确定下来。

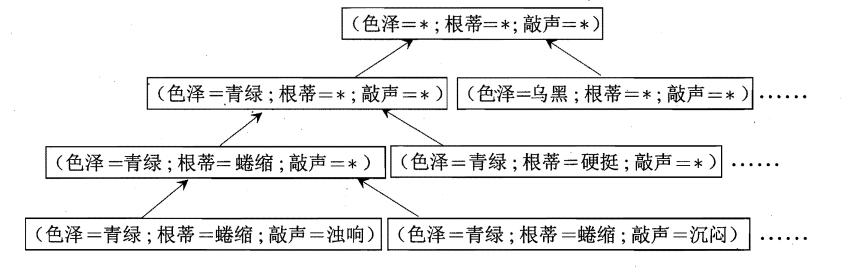

可以把学习的过程看作在所有假设的空间中进行搜索的过程,搜索目标是找到与训练集“匹配”的假设,即能够将训练集中的瓜判断正确的假设。假设确定了,假设空间及其规模大小也就确定了。

例子中假设空间由形如“(色泽=?)∧(根蒂=?)∧(敲声=?)”的可能取值所形成的假设组成。

例如色泽有“青绿”、“乌黑”、“浅白”三种可能取值还有一种情况色泽无论取什么值都合适(🦆:第4种情况),此时用通配符“*”表示,例如好瓜$\Leftrightarrow$(色泽=*)∧(根蒂=蜷缩)∧(敲声=响浊)。还有一种极端情况,不存在“好瓜”这个概念,则用$\varnothing$表示。

因此若“色泽”、“根蒂”、“敲声”分别有3、2、2种取值,则假设空间规模的大小为4×3×3+1=37。假设空间:

有很多策略对这假设空间:

- 自顶向下、从一般到特殊

- 自底向上、从特殊到一般

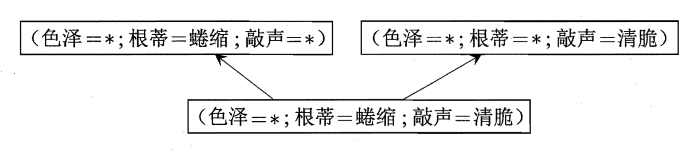

搜索过程中可以不断删除与正例不一致的假设和与反例一致的假设,最终得到获得与训练集一致的假设。但假设空间可能很大,而基于有限样本训练集进行,因此可能有多个假设与训练集一致的假设集合,称之为版本空间。如

归纳偏好

对于一个具体的学习算法而言,它必须要产生一个模型,学习算法本身的偏好就会起到关键作用。

机器学习算法在学习过程中对某种类型假设的偏好称为归纳偏好。

任何一个有效的机器学习算法必有其归纳偏好。

常用归纳原则:奥卡姆剃刀————“若有多个假设与观察一致,则选最简单的那个”。

🦆yili:奥卡姆剃刀并非唯一可行原则,也不一定就优于其他假设

发展历程

机器学习是人工智能研究发展到一定阶段的必然产物。

介绍了好多有的没的发展历程(ノへ ̄、)。

《人工智能手册》将机器学习划分为:

- 机器学习:死记硬背式学习;

- 示教学习:从指令中学习;

- 类比学习:通过观察和发现学习;

- 归纳学习:从样例中学习。

应用现状

机器学习在很多计算机科学的分支领域中都有体现,尤其是计算机视觉、自然语言处理等领域;机器学习还为许多交叉学科提供技术支撑。

科学研究从传统的“理论+实验”逐渐转变为“理论+实验+计算”。

大数据时代三大关键技术:机器学习、云计算、众包。

数据挖掘与机器学习:

数据挖掘是从海量数据中挖掘知识,这必然涉及对海量数据的管理与分析:

- 数据库领域研究为数据挖掘提供数据管理技术;

- 机器学习和统计学的研究为数据挖掘提供数据分析技术。

课后习题

(1.1求西瓜训练集的样本空间

西瓜训练集表中若只包含编号为1和4的两个样例,试给出相应的版本空间。

| 编号 | 色泽 | 根蒂 | 敲声 | 好瓜 |

|---|---|---|---|---|

| 1 | 青绿 | 蜷缩 | 浊响 | 是 |

| 4 | 乌黑 | 稍蜷 | 闷响 | 否 |

解:

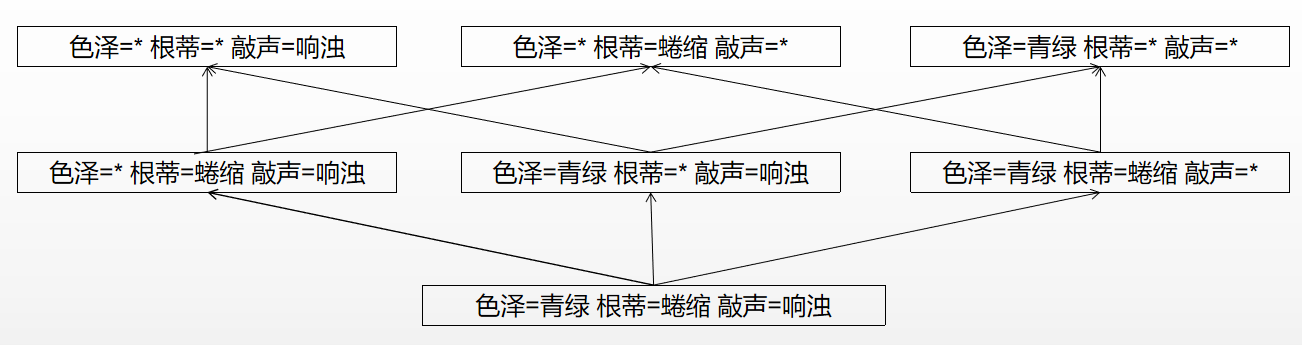

版本空间的求法为遍历假设空间,不断删除与正例不一致的假设和(或)与反例一致的假设

版本空间可以有:

- 删除不能包含正例以及包含任意反例的假设

- 删除包含任意反例的假设

采用第一种方法删减假设空间

当前特征维度为3,共2、2、2取值

假设空间规模:3×3×3+1=28

有点小多,就不画了

版本空间为:

(1.2求假设的可能性种类,假设空间规模

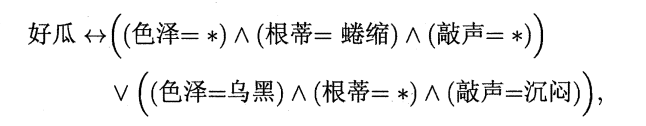

与使用单个合取式来进行假设表示相比,使用“析合范式”将使得假设空间具有更强的表示能力,例如:

会把“(色泽=青绿)∧(根蒂=蜷缩)∧(敲声=清脆)”以及“(色泽=乌黑)∧(根蒂=硬挺)∧(敲声=沉闷)”都分类为“好瓜”。若使用最多包含k个合取式的析合范式来表达表中西瓜分类问题的假设空间,试估算共有多少种可能的假设。

| 编号 | 色泽 | 根蒂 | 敲声 | 好瓜 |

|---|---|---|---|---|

| 1 | 青绿 | 蜷缩 | 浊响 | 是 |

| 2 | 乌黑 | 蜷缩 | 浊响 | 是 |

| 3 | 青绿 | 硬挺 | 清脆 | 否 |

| 4 | 乌黑 | 稍蜷 | 闷响 | 否 |

解:

https://blog.csdn.net/dicker6315/article/details/81265066

(1.3假设选择设计

若数据包含噪声,则假设空间中有可能不存在与所有训练样本都一致的假设在此情形下,试设计一种归纳偏好用于假设选择。

解:

数据含有噪声,可能存在特征都相同,标记不同。

- 假设选择的时候只去除与反例一致的假设或只去除与正例不一致的假设(将特征向量相同而标记不同的确定为正例或确定为反例);

- 统计特征向量相同不同标记的出现的频率,将该特征的标记定为频率最大的一类。~如 该特征向量下有500个是好瓜,有50个不是好瓜,则定义为好瓜。~

(1.4用其他方式“没有免费的午餐”定理

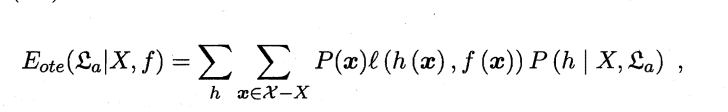

本章1.4节在论述“没有免费的午餐”定理时,默认使用了“分类错误率”作为性能度量来对分类器进行评估。若换用其他性能度量l,则式(1.1)将改为

试证明“没有免费的午餐定理”仍成立。

(1.5机器学习在搜索上的应用

试述机器学习能在互联网搜索的哪些环节起什么作用.

解:

- 按搜索词匹配结果,并按一定算法排序结果;

- “猜你在找” 推送与搜索词条相关的搜索词条(搜索了这个词条的人还搜索了什么,或相关性大的搜索词);

- 记录操作者浏览习惯,提高猜测其感兴趣的结果。